Xây dựng công cụ hỗ trợ đọc xuất bản phẩm lưu chiểu dựa trên phương pháp đối sánh ảnh tài liệu

Nghiên cứu được thực hiện qua nhiều công đoạn như rút trích đặc trưng cục

bộ cho ảnh, sau đó thực hiện phân vùng ảnh với thuật toán DBSCAN

(Density-Based Spatial Clustering of Application with Noise), gom cụm các

đặc trưng cục bộ và đối sánh từng vùng ảnh tài liệu với giải thuật đối sánh

các đặc trưng cục bộ SIFT, SURF. Cuối cùng là xác định được các vùng bị

sai khác, sai vị trí của ảnh tài liệu xin cấp phép in và ảnh tài liệu đã được in.

Phương pháp nghiên cứu đưa ra có khả năng phân rã được ảnh tài liệu

thành từng khối riêng biệt (tiêu đề, hình ảnh, đoạn văn bản, bảng biểu),

không sử dụng máy học cũng như không cần biết trước bố cục cụ thể của ảnh

tài liệu; hiệu quả đối sánh ảnh chính xác hơn vì chỉ sử dụng từng vùng ảnh

đã phân rã để đối sánh và phát hiện sai khác, thay vì sử dụng toàn bộ ảnh để

đối sánh. Kết quả thực nghiệm trên 223 ảnh tài liệu được thu tập tại bộ phận

đọc lưu chiểu, cho thấy độ chính xác đạt được của phương pháp đề xuất là

91%, và đã tìm ra được những vùng ảnh khác nhau trên hai ảnh tài liệu,

cũng như tìm ra được những vùng bị sai vị trí về bố cục trên hai ảnh tài liệu.

Trang 1

Trang 2

Trang 3

Trang 4

Trang 5

Trang 6

Trang 7

Trang 8

Trang 9

Trang 10

Tải về để xem bản đầy đủ

Tóm tắt nội dung tài liệu: Xây dựng công cụ hỗ trợ đọc xuất bản phẩm lưu chiểu dựa trên phương pháp đối sánh ảnh tài liệu

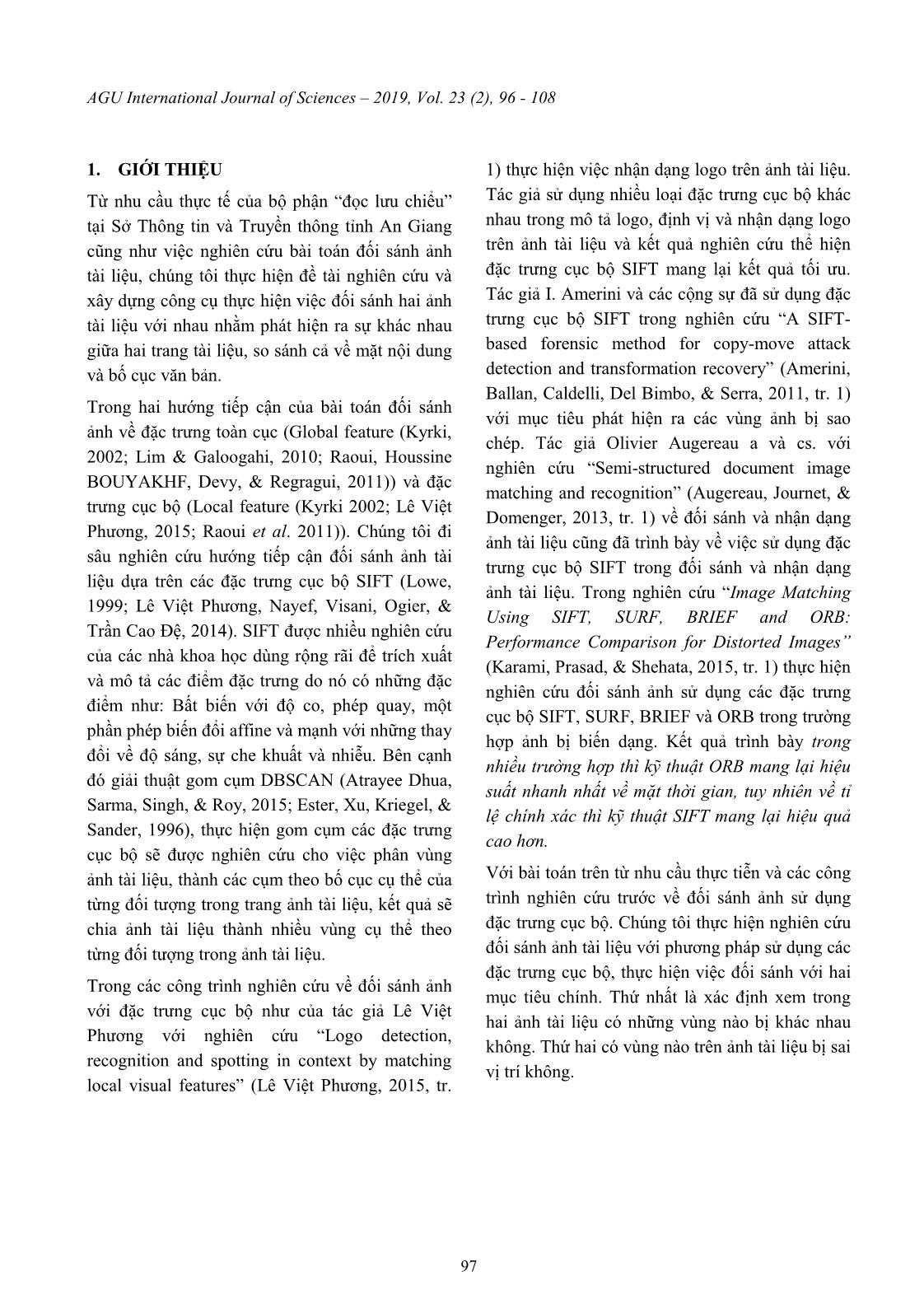

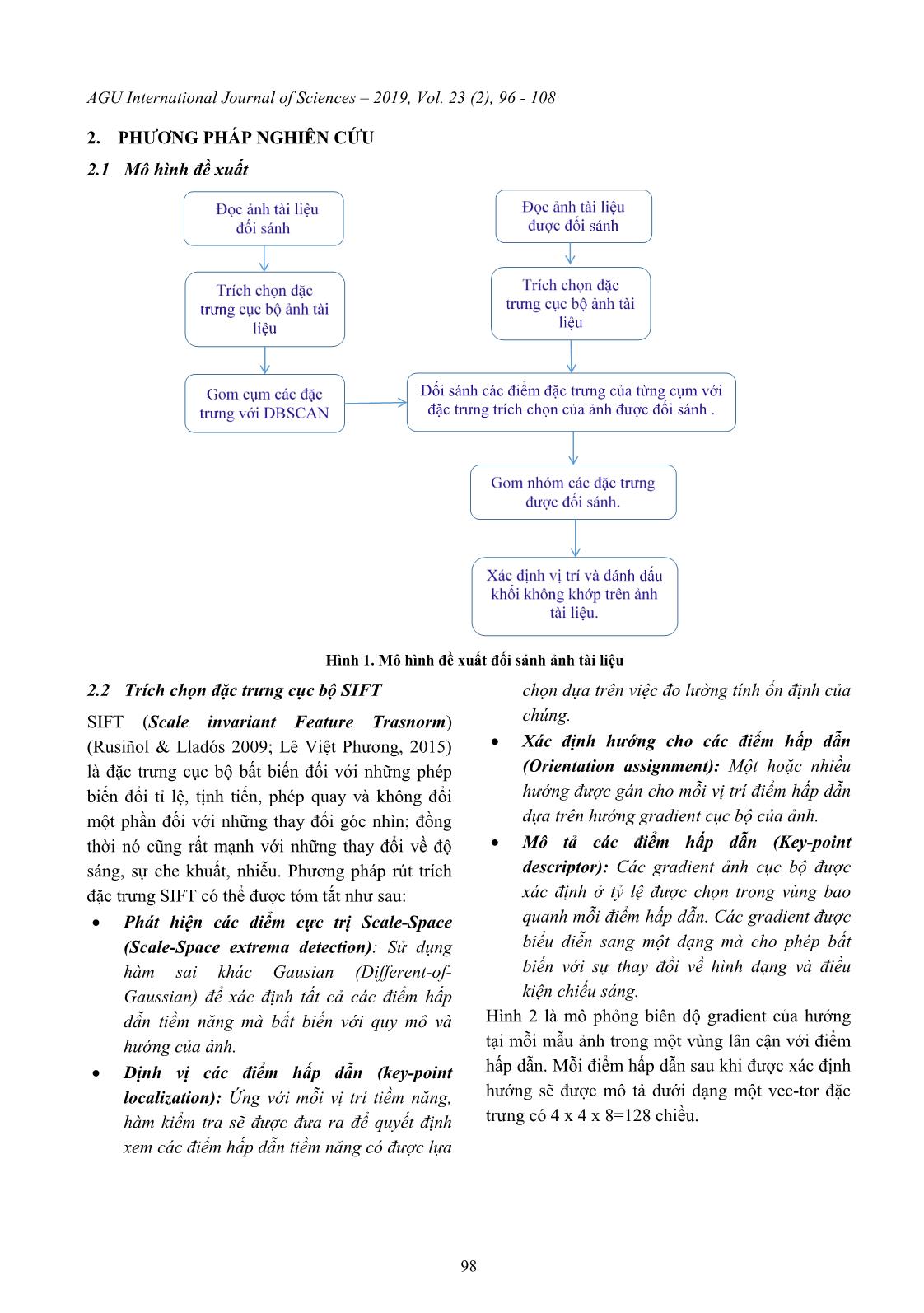

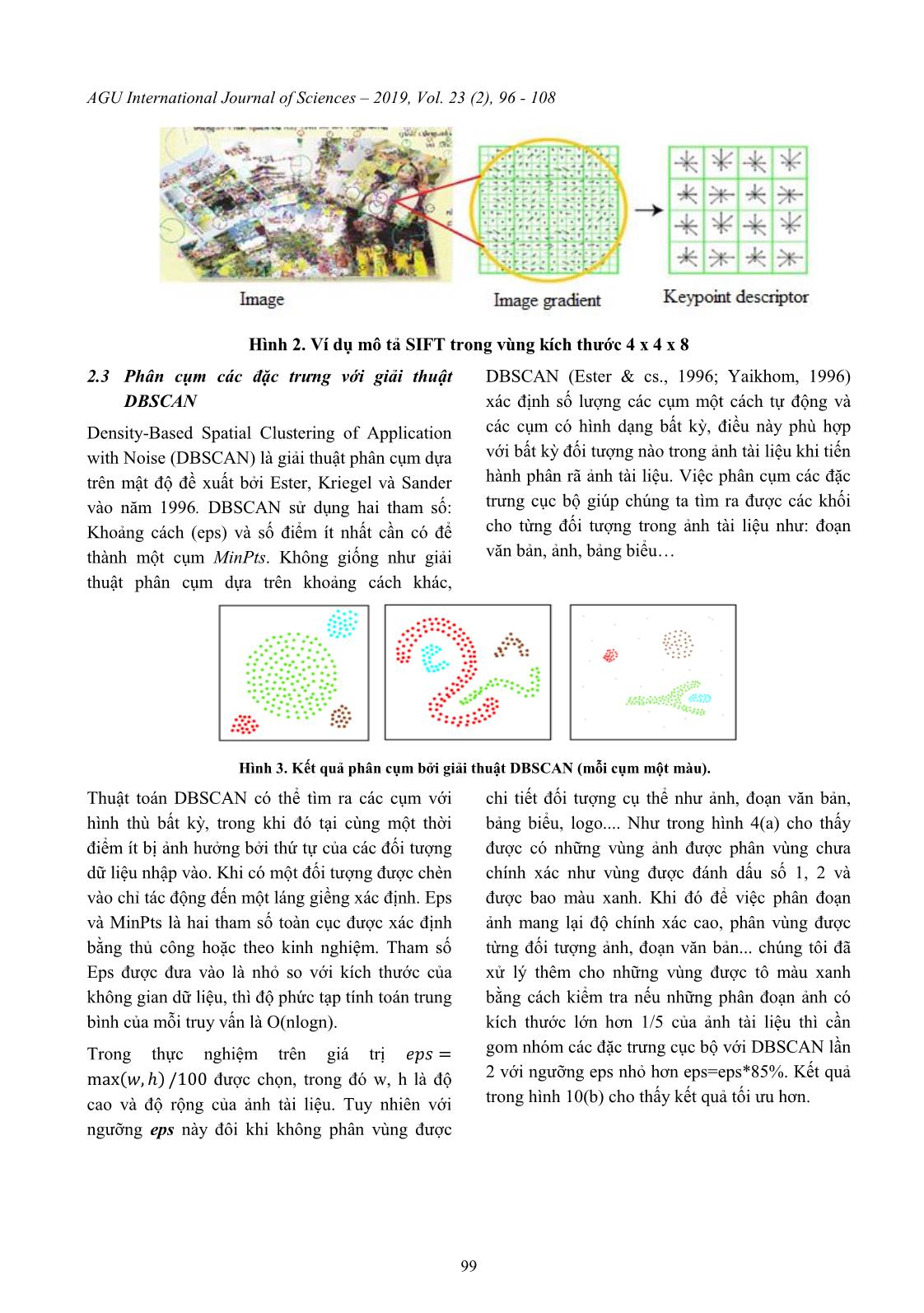

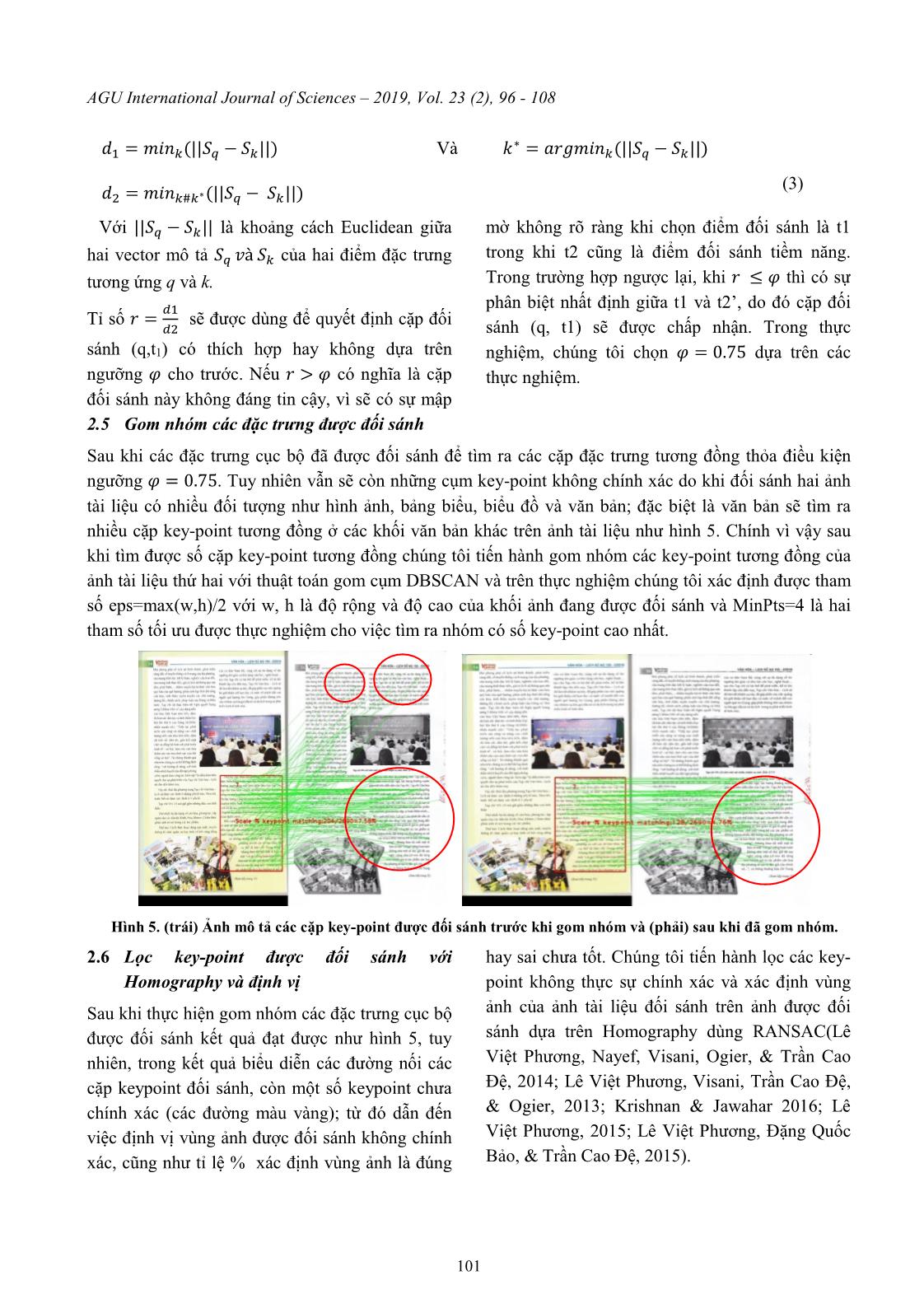

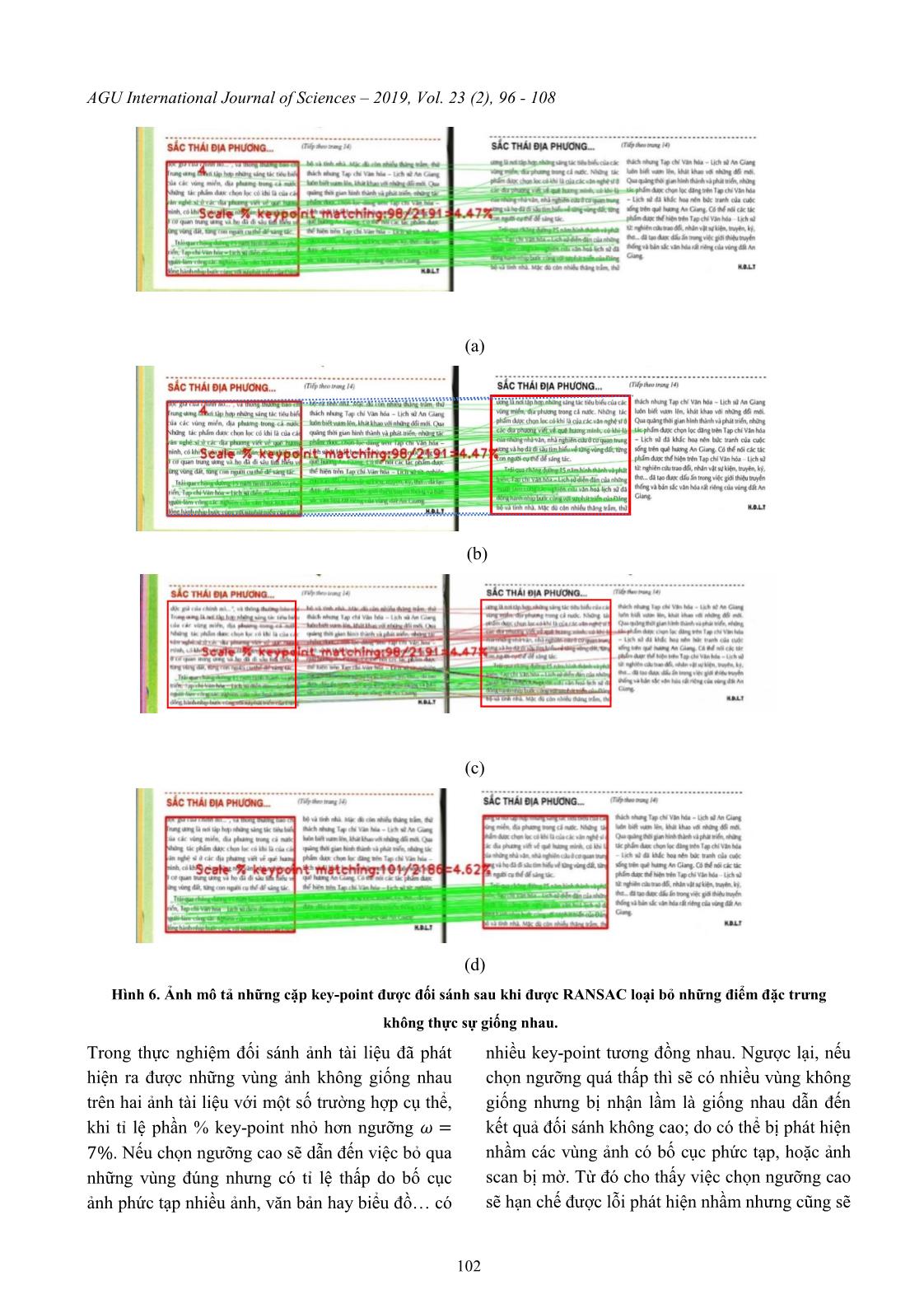

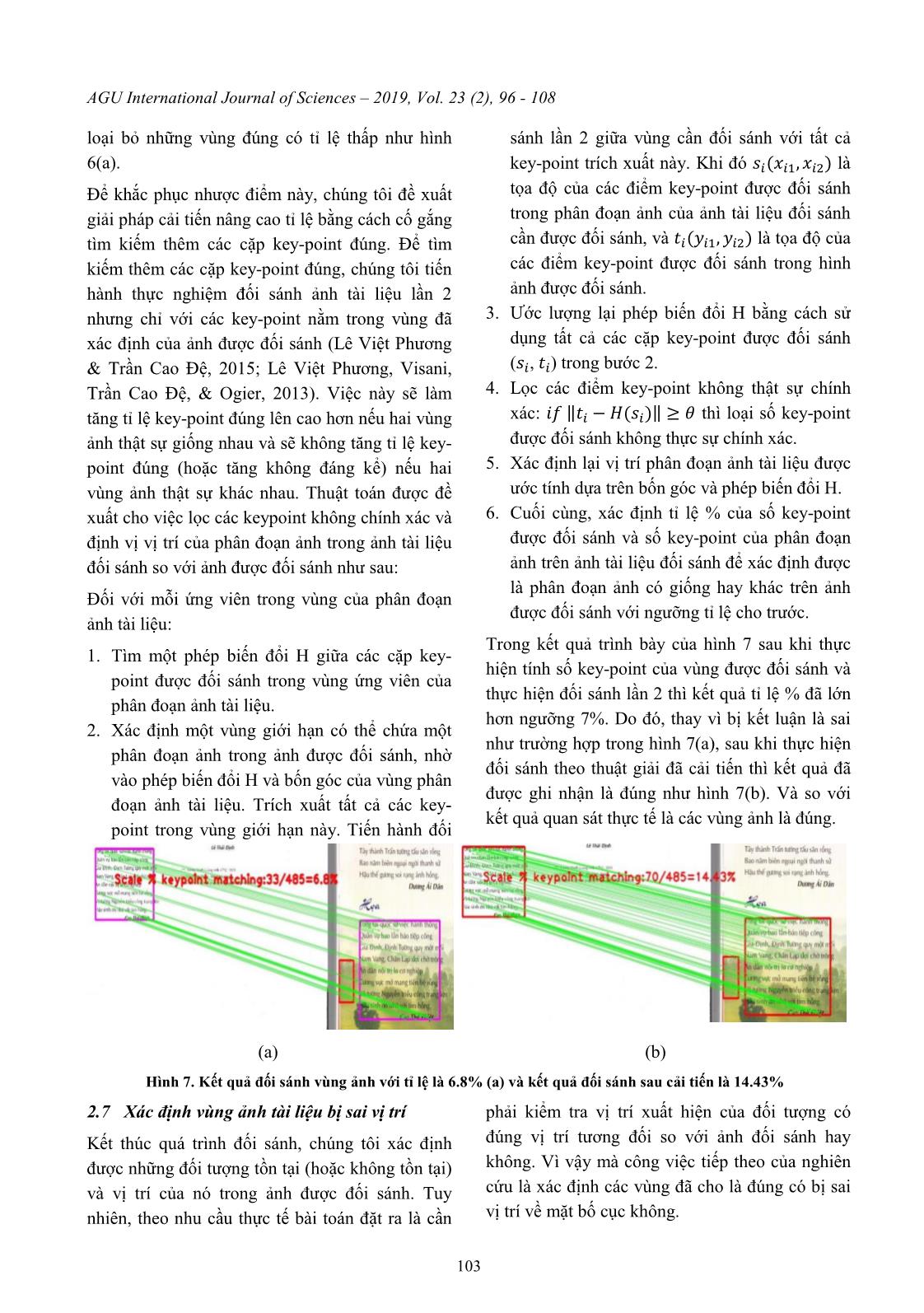

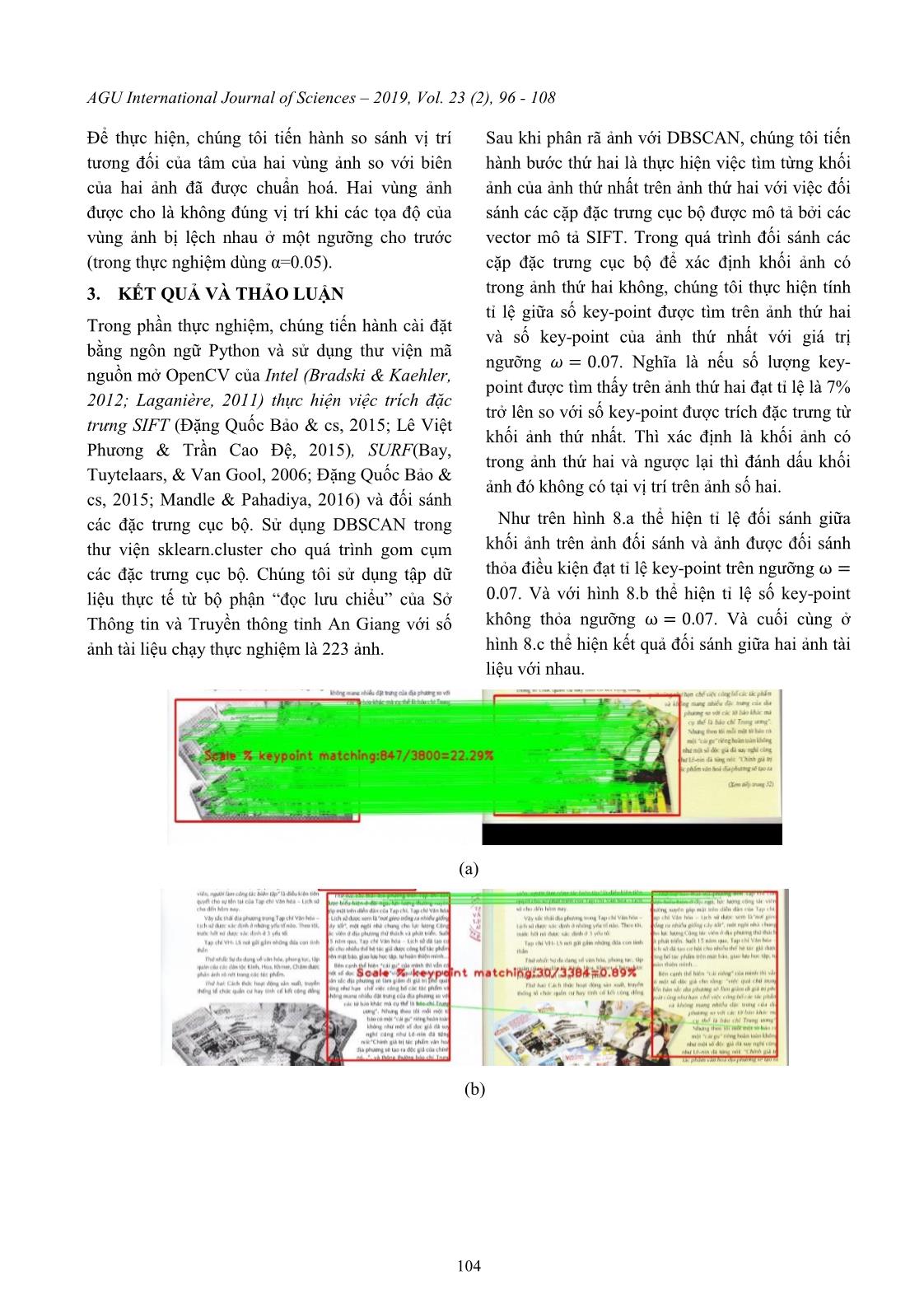

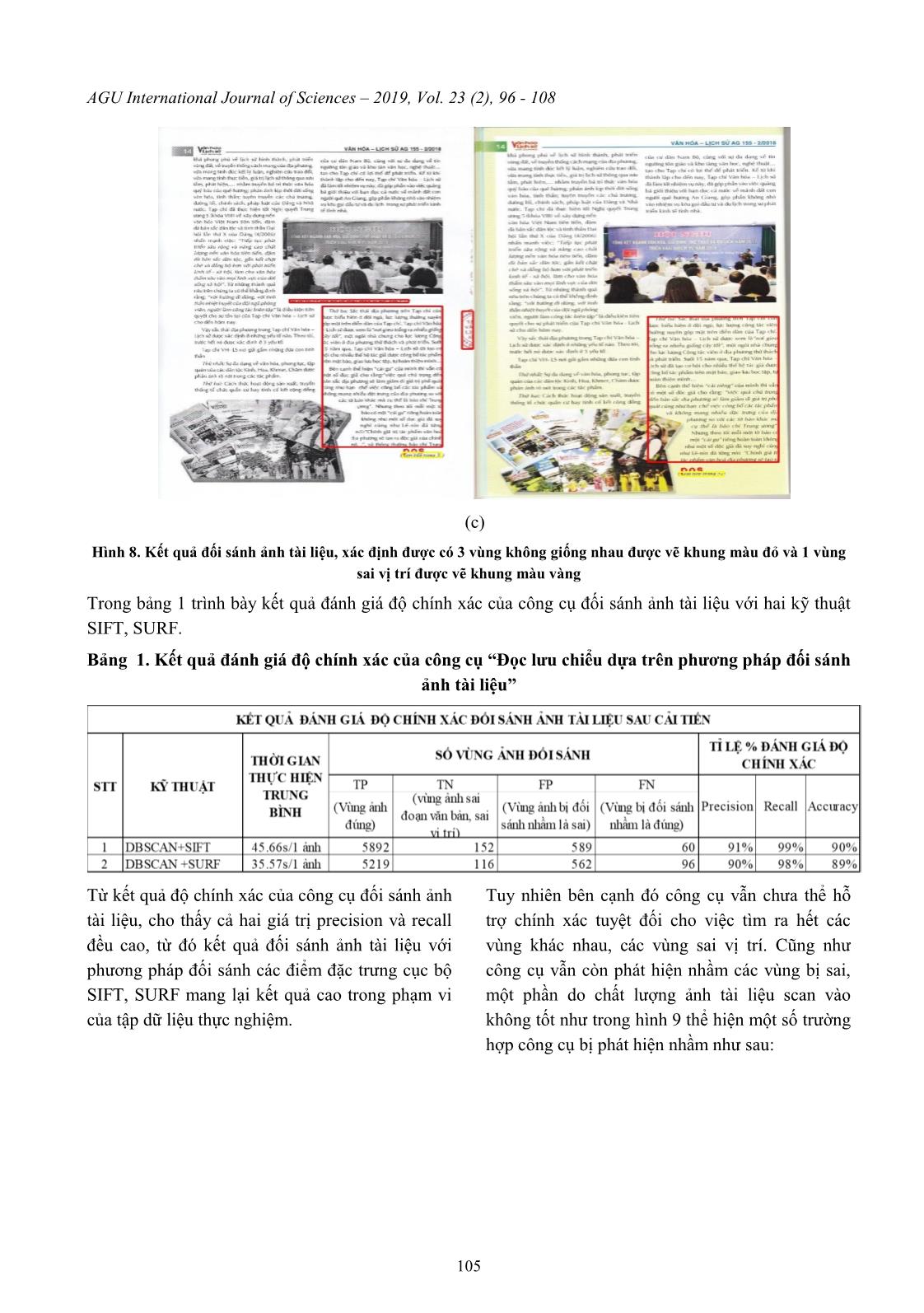

AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 96 XÂY DỰNG CÔNG CỤ HỖ TRỢ ĐỌC XUẤT BẢN PHẨM LƯU CHIỂU DỰA TRÊN PHƯƠNG PHÁP ĐỐI SÁNH ẢNH TÀI LIỆU Phạm Thị Minh Thư1, Lê Việt Phương1 1Trường Cao đẳng nghề An Giang 2Sở Thông Tin và Truyền Thông Tỉnh An Giang Thông tin chung: Ngày nhận bài: 01/10/2018 Ngày nhận kết quả bình duyệt: 14/11/2018 Ngày chấp nhận đăng: 08/2019 Title: A supportive tool for reading depository publications based on document image matching Keywords: Document images matching, local feature, DBSCAN, SIFT, SURF Từ khóa: Đối sánh ảnh tài liệu, gom cụm DBSCAN, đặc trưng SIFT, SURF ABSTRACT The research was carried out in many stages such as local features extraction image, then segmenting the image by DBSCAN algorithm (Density-Based Spatial Clustering of Application with Noise), clustering local features and comparing each document image area to matching local features algorithms (SIFT, SURF). Finally, determining the mismatched areas, wrong positions of licensing printing and has been printed document images. The propose method is capable to decay document images into each separated block (title, image, paragraph, table), do not use machine learning and do not need to know the detail layout of document images previously; the matching performance is more accurately because of only using each decayed image region to matching and detect the differences instead of using all document images. The experimental result on 223 document images were collected at “Read Depositary” part, presented the accuracy of the propose method is 91%, also found the difference image regions between two document images and found the wrong position about layout on two document images. TÓM TẮT Nghiên cứu được thực hiện qua nhiều công đoạn như rút trích đặc trưng cục bộ cho ảnh, sau đó thực hiện phân vùng ảnh với thuật toán DBSCAN (Density-Based Spatial Clustering of Application with Noise), gom cụm các đặc trưng cục bộ và đối sánh từng vùng ảnh tài liệu với giải thuật đối sánh các đặc trưng cục bộ SIFT, SURF. Cuối cùng là xác định được các vùng bị sai khác, sai vị trí của ảnh tài liệu xin cấp phép in và ảnh tài liệu đã được in. Phương pháp nghiên cứu đưa ra có khả năng phân rã được ảnh tài liệu thành từng khối riêng biệt (tiêu đề, hình ảnh, đoạn văn bản, bảng biểu), không sử dụng máy học cũng như không cần biết trước bố cục cụ thể của ảnh tài liệu; hiệu quả đối sánh ảnh chính xác hơn vì chỉ sử dụng từng vùng ảnh đã phân rã để đối sánh và phát hiện sai khác, thay vì sử dụng toàn bộ ảnh để đối sánh. Kết quả thực nghiệm trên 223 ảnh tài liệu được thu tập tại bộ phận đọc lưu chiểu, cho thấy độ chính xác đạt được của phương pháp đề xuất là 91%, và đã tìm ra được những vùng ảnh khác nhau trên hai ảnh tài liệu, cũng như tìm ra được những vùng bị sai vị trí về bố cục trên hai ảnh tài liệu. AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 97 1. GIỚI THIỆU Từ nhu cầu thực tế của bộ phận “đọc lưu chiểu” tại Sở Thông tin và Truyền thông tỉnh An Giang cũng như việc nghiên cứu bài toán đối sánh ảnh tài liệu, chúng tôi thực hiện đề tài nghiên cứu và xây dựng công cụ thực hiện việc đối sánh hai ảnh tài liệu với nhau nhằm phát hiện ra sự khác nhau giữa hai trang tài liệu, so sánh cả về mặt nội dung và bố cục văn bản. Trong hai hướng tiếp cận của bài toán đối sánh ảnh về đặc trưng toàn cục (Global feature (Kyrki, 2002; Lim & Galoogahi, 2010; Raoui, Houssine BOUYAKHF, Devy, & Regragui, 2011)) và đặc trưng cục bộ (Local feature (Kyrki 2002; Lê Việt Phương, 2015; Raoui et al. 2011)). Chúng tôi đi sâu nghiên cứu hướng tiếp cận đối sánh ảnh tài liệu dựa trên các đặc trưng cục bộ SIFT (Lowe, 1999; Lê Việt Phương, Nayef, Visani, Ogier, & Trần Cao Đệ, 2014). SIFT được nhiều nghiên cứu của các nhà khoa học dùng rộng rãi để trích xuất và mô tả các điểm đặc trưng do nó có những đặc điểm như: Bất biến với độ co, phép quay, một phần phép biến đổi affine và mạnh với những thay đổi về độ sáng, sự che khuất và nhiễu. Bên cạnh đó giải thuật gom cụm DBSCAN (Atrayee Dhua, Sarma, Singh, & Roy, 2015; Ester, Xu, Kriegel, & Sander, 1996), thực hiện gom cụm các đặc trưng cục bộ sẽ được nghiên cứu cho việc phân vùng ảnh tài liệu, thành các cụm theo bố cục cụ thể của từng đối tượng trong trang ảnh tài liệu, kết quả sẽ chia ảnh tài liệu thành nhiều vùng cụ thể theo từng đối tượng trong ảnh tài liệu. Trong các công trình nghiên cứu về đối sánh ảnh với đặc trưng cục bộ như của tác giả Lê Việt Phương với nghiên cứu “Logo detection, recognition and spotting in context by matching local visual features” (Lê Việt Phương, 2015, tr. 1) thực hiện việc nhận dạng logo trên ảnh tài liệu. Tác giả sử dụng nhiều loại đặc trưng cục bộ khác nhau trong mô tả logo, định vị và nhận dạng logo trên ảnh tài liệu và kết quả nghiên cứu thể hiện đặc trư ... àu vàng); từ đó dẫn đến việc định vị vùng ảnh được đối sánh không chính xác, cũng như tỉ lệ % xác định vùng ảnh là đúng hay sai chưa tốt. Chúng tôi tiến hành lọc các key- point không thực sự chính xác và xác định vùng ảnh của ảnh tài liệu đối sánh trên ảnh được đối sánh dựa trên Homography dùng RANSAC(Lê Việt Phương, Nayef, Visani, Ogier, & Trần Cao Đệ, 2014; Lê Việt Phương, Visani, Trần Cao Đệ, & Ogier, 2013; Krishnan & Jawahar 2016; Lê Việt Phương, 2015; Lê Việt Phương, Đặng Quốc Bảo, & Trần Cao Đệ, 2015). AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 102 (a) (b) (c) (d) Hình 6. Ảnh mô tả những cặp key-point được đối sánh sau khi được RANSAC loại bỏ những điểm đặc trưng không thực sự giống nhau. Trong thực nghiệm đối sánh ảnh tài liệu đã phát hiện ra được những vùng ảnh không giống nhau trên hai ảnh tài liệu với một số trường hợp cụ thể, khi tỉ lệ phần % key-point nhỏ hơn ngưỡng 𝜔 = 7%. Nếu chọn ngưỡng cao sẽ dẫn đến việc bỏ qua những vùng đúng nhưng có tỉ lệ thấp do bố cục ảnh phức tạp nhiều ảnh, văn bản hay biểu đồ có nhiều key-point tương đồng nhau. Ngược lại, nếu chọn ngưỡng quá thấp thì sẽ có nhiều vùng không giống nhưng bị nhận lầm là giống nhau dẫn đến kết quả đối sánh không cao; do có thể bị phát hiện nhầm các vùng ảnh có bố cục phức tạp, hoặc ảnh scan bị mờ. Từ đó cho thấy việc chọn ngưỡng cao sẽ hạn chế được lỗi phát hiện nhầm nhưng cũng sẽ AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 103 loại bỏ những vùng đúng có tỉ lệ thấp như hình 6(a). Để khắc phục nhược điểm này, chúng tôi đề xuất giải pháp cải tiến nâng cao tỉ lệ bằng cách cố gắng tìm kiếm thêm các cặp key-point đúng. Để tìm kiếm thêm các cặp key-point đúng, chúng tôi tiến hành thực nghiệm đối sánh ảnh tài liệu lần 2 nhưng chỉ với các key-point nằm trong vùng đã xác định của ảnh được đối sánh (Lê Việt Phương & Trần Cao Đệ, 2015; Lê Việt Phương, Visani, Trần Cao Đệ, & Ogier, 2013). Việc này sẽ làm tăng tỉ lệ key-point đúng lên cao hơn nếu hai vùng ảnh thật sự giống nhau và sẽ không tăng tỉ lệ key- point đúng (hoặc tăng không đáng kể) nếu hai vùng ảnh thật sự khác nhau. Thuật toán được đề xuất cho việc lọc các keypoint không chính xác và định vị vị trí của phân đoạn ảnh trong ảnh tài liệu đối sánh so với ảnh được đối sánh như sau: Đối với mỗi ứng viên trong vùng của phân đoạn ảnh tài liệu: 1. Tìm một phép biến đổi H giữa các cặp key- point được đối sánh trong vùng ứng viên của phân đoạn ảnh tài liệu. 2. Xác định một vùng giới hạn có thể chứa một phân đoạn ảnh trong ảnh được đối sánh, nhờ vào phép biến đổi H và bốn góc của vùng phân đoạn ảnh tài liệu. Trích xuất tất cả các key- point trong vùng giới hạn này. Tiến hành đối sánh lần 2 giữa vùng cần đối sánh với tất cả key-point trích xuất này. Khi đó 𝑠𝑖(𝑥𝑖1, 𝑥𝑖2) là tọa độ của các điểm key-point được đối sánh trong phân đoạn ảnh của ảnh tài liệu đối sánh cần được đối sánh, và 𝑡𝑖(𝑦𝑖1, 𝑦𝑖2) là tọa độ của các điểm key-point được đối sánh trong hình ảnh được đối sánh. 3. Ước lượng lại phép biến đổi H bằng cách sử dụng tất cả các cặp key-point được đối sánh (𝑠𝑖, 𝑡𝑖) trong bước 2. 4. Lọc các điểm key-point không thật sự chính xác: 𝑖𝑓 ‖𝑡𝑖 − 𝐻(𝑠𝑖)‖ ≥ 𝜃 thì loại số key-point được đối sánh không thực sự chính xác. 5. Xác định lại vị trí phân đoạn ảnh tài liệu được ước tính dựa trên bốn góc và phép biến đổi H. 6. Cuối cùng, xác định tỉ lệ % của số key-point được đối sánh và số key-point của phân đoạn ảnh trên ảnh tài liệu đối sánh để xác định được là phân đoạn ảnh có giống hay khác trên ảnh được đối sánh với ngưỡng tỉ lệ cho trước. Trong kết quả trình bày của hình 7 sau khi thực hiện tính số key-point của vùng được đối sánh và thực hiện đối sánh lần 2 thì kết quả tỉ lệ % đã lớn hơn ngưỡng 7%. Do đó, thay vì bị kết luận là sai như trường hợp trong hình 7(a), sau khi thực hiện đối sánh theo thuật giải đã cải tiến thì kết quả đã được ghi nhận là đúng như hình 7(b). Và so với kết quả quan sát thực tế là các vùng ảnh là đúng. (a) (b) Hình 7. Kết quả đối sánh vùng ảnh với tỉ lệ là 6.8% (a) và kết quả đối sánh sau cải tiến là 14.43% 2.7 Xác định vùng ảnh tài liệu bị sai vị trí Kết thúc quá trình đối sánh, chúng tôi xác định được những đối tượng tồn tại (hoặc không tồn tại) và vị trí của nó trong ảnh được đối sánh. Tuy nhiên, theo nhu cầu thực tế bài toán đặt ra là cần phải kiểm tra vị trí xuất hiện của đối tượng có đúng vị trí tương đối so với ảnh đối sánh hay không. Vì vậy mà công việc tiếp theo của nghiên cứu là xác định các vùng đã cho là đúng có bị sai vị trí về mặt bố cục không. AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 104 Để thực hiện, chúng tôi tiến hành so sánh vị trí tương đối của tâm của hai vùng ảnh so với biên của hai ảnh đã được chuẩn hoá. Hai vùng ảnh được cho là không đúng vị trí khi các tọa độ của vùng ảnh bị lệch nhau ở một ngưỡng cho trước (trong thực nghiệm dùng α=0.05). 3. KẾT QUẢ VÀ THẢO LUẬN Trong phần thực nghiệm, chúng tiến hành cài đặt bằng ngôn ngữ Python và sử dụng thư viện mã nguồn mở OpenCV của Intel (Bradski & Kaehler, 2012; Laganière, 2011) thực hiện việc trích đặc trưng SIFT (Đặng Quốc Bảo & cs, 2015; Lê Việt Phương & Trần Cao Đệ, 2015), SURF(Bay, Tuytelaars, & Van Gool, 2006; Đặng Quốc Bảo & cs, 2015; Mandle & Pahadiya, 2016) và đối sánh các đặc trưng cục bộ. Sử dụng DBSCAN trong thư viện sklearn.cluster cho quá trình gom cụm các đặc trưng cục bộ. Chúng tôi sử dụng tập dữ liệu thực tế từ bộ phận “đọc lưu chiểu” của Sở Thông tin và Truyền thông tỉnh An Giang với số ảnh tài liệu chạy thực nghiệm là 223 ảnh. Sau khi phân rã ảnh với DBSCAN, chúng tôi tiến hành bước thứ hai là thực hiện việc tìm từng khối ảnh của ảnh thứ nhất trên ảnh thứ hai với việc đối sánh các cặp đặc trưng cục bộ được mô tả bởi các vector mô tả SIFT. Trong quá trình đối sánh các cặp đặc trưng cục bộ để xác định khối ảnh có trong ảnh thứ hai không, chúng tôi thực hiện tính tỉ lệ giữa số key-point được tìm trên ảnh thứ hai và số key-point của ảnh thứ nhất với giá trị ngưỡng 𝜔 = 0.07. Nghĩa là nếu số lượng key- point được tìm thấy trên ảnh thứ hai đạt tỉ lệ là 7% trở lên so với số key-point được trích đặc trưng từ khối ảnh thứ nhất. Thì xác định là khối ảnh có trong ảnh thứ hai và ngược lại thì đánh dấu khối ảnh đó không có tại vị trí trên ảnh số hai. Như trên hình 8.a thể hiện tỉ lệ đối sánh giữa khối ảnh trên ảnh đối sánh và ảnh được đối sánh thỏa điều kiện đạt tỉ lệ key-point trên ngưỡng ω = 0.07. Và với hình 8.b thể hiện tỉ lệ số key-point không thỏa ngưỡng ω = 0.07. Và cuối cùng ở hình 8.c thể hiện kết quả đối sánh giữa hai ảnh tài liệu với nhau. (a) (b) AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 105 (c) Hình 8. Kết quả đối sánh ảnh tài liệu, xác định được có 3 vùng không giống nhau được vẽ khung màu đỏ và 1 vùng sai vị trí được vẽ khung màu vàng Trong bảng 1 trình bày kết quả đánh giá độ chính xác của công cụ đối sánh ảnh tài liệu với hai kỹ thuật SIFT, SURF. Bảng 1. Kết quả đánh giá độ chính xác của công cụ “Đọc lưu chiểu dựa trên phương pháp đối sánh ảnh tài liệu” Từ kết quả độ chính xác của công cụ đối sánh ảnh tài liệu, cho thấy cả hai giá trị precision và recall đều cao, từ đó kết quả đối sánh ảnh tài liệu với phương pháp đối sánh các điểm đặc trưng cục bộ SIFT, SURF mang lại kết quả cao trong phạm vi của tập dữ liệu thực nghiệm. Tuy nhiên bên cạnh đó công cụ vẫn chưa thể hỗ trợ chính xác tuyệt đối cho việc tìm ra hết các vùng khác nhau, các vùng sai vị trí. Cũng như công cụ vẫn còn phát hiện nhầm các vùng bị sai, một phần do chất lượng ảnh tài liệu scan vào không tốt như trong hình 9 thể hiện một số trường hợp công cụ bị phát hiện nhầm như sau: AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 106 (a:Nguyên nhân do bản in và bản xin cấp phép khi scan bị mờ) (b: Nguyên nhân ảnh tài liệu khi scan bị mất thông tin thực tế so với bản in ) (c: Số lượng keypoint được phát hiện không đủ % ngưỡng xác định là đúng) Hình 9. Ảnh bị phát hiện các vùng ảnh bị sai không đúng thực thực tế quan sát. AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 107 4. KẾT LUẬN VÀ KHUYẾN NGHỊ Bài báo đã trình bày giải pháp đối sánh ảnh tài liệu với mục tiêu tìm ra được những vùng không giống nhau, sai vị trí trên hai ảnh tài liệu. Với mô hình đề xuất đối sánh ảnh tài liệu qua năm giai đoạn: (1) Trích đặc trưng cục bộ ảnh tài liệu với đặc trưng cục bộ SIFT, SURF; (2) Gom cụm các đặc trưng cục bộ với DBSCAN và gom cụm lại khi vùng ảnh được gom lớn hơn 1/5 kích thước ảnh tài liệu; (3) Đối sánh các đặc trưng cục bộ; (4) Định vị và xác định vị trí của vùng đối sánh (Homography dùng RANSAC); (5) Xác định vùng ảnh sai vị trí với đề xuất xác định tỉ lệ khoảng cách từ tâm vùng ảnh đến biên ảnh. Kết quả thực nghiệm cho thấy phương pháp đề xuất đạt được độ chính xác cao có thể hỗ trợ cho công tác đọc lưu chiểu. Trong tương lai chúng tôi sẽ ứng dụng kết quả nghiên cứu trong các hệ thống văn phòng điện tử đáp ứng nhu cầu thực tế như: Xây dựng hệ thống đối chiếu văn bản đã phát hành của một cơ quan đơn vị, chấm bài thi tin học văn phòng tự động qua ảnh kết quả bài thi... Bên cạnh đó, chúng tôi tiếp tục nghiên cứu các giải thuật phân vùng và đối sánh ảnh tài liệu cũng như việc kết hợp thêm các đặc trưng khác về màu sắc, hình dạng, kết cấu... với mục tiêu nâng cao khả năng đối sánh ảnh tài liệu. TÀI LIỆU THAM KHẢO Amerini, I., Ballan, L., Caldelli, R., Del Bimbo, A., & Serra, G. (2011). A SIFT-based forensic method for copy-move attack detection and transformation recovery. IEEE Transactions on Information Forensics and Security, 6(3 PART 2), 1099–1110. https://doi.org/10.1109/TIFS.2011.2129512 Atrayee Dhua, Sarma, D. N., Singh, S., & Roy, B. (2015). Segmentation of Images using Density-Based Algorithms. International Journal of Advanced Research in Computer and Communication Engineering, 4 (5), 273– 278. https://doi.org/10.17148/IJARCCE.2015.4561 Augereau, O., Journet, N., & Domenger, J.-P. (2013). Semi-structured document image matching and recognition, 8658, 865804. https://doi.org/10.1117/12.2003911 Calonder, M., Lepetit, V., Strecha, C., & Fua, P. (2010). BRIEF: Binary robust independent elementary features. Lecture Notes in Computer Science (Including Subseries Lecture Notes in Artificial Intelligence and Lecture Notes in Bioinformatics), 6314 LNCS(PART 4), 778–792. https://doi.org/10.1007/978-3-642-15561-1_56 Đặng Quốc Bảo., Lê Việt Phương., Luqman, M. M., Coustaty, M., Trần Cao Đệ., & Ogier, J.- M. (2015). Camera-based document image retrieval system using local features - comparing SRIF with LLAH, SIFT, SURF and ORB. In 2015 13th International Conference on Document Analysis and Recognition (ICDAR) (pp. 1211–1215). IEEE. https://doi.org/10.1109/ICDAR.2015.7333956 Edla, D. R., & Jana, P. K. (2012). A Prototype- Based Modified DBSCAN for Gene Clustering. Procedia Technology, 6, 485–492. https://doi.org/10.1016/j.protcy.2012.10.058 Ester, M., Xu, X., Kriegel, H., & Sander, J. (1996). Density-based algorithm for discovering clusters in large spatial databases with noise. Proc. Acm Sigkdd Int. Conf. Knowl. Discov. Data Min., pages, 226–231. Retrieved from 1507 Holzinger, W. E., Löcker, H., & Löcker, B. (2008). Fulgoromorpha of Seychelles: A preliminary checklist. Bulletin of Insectology, 61(1), 121–122. https://doi.org/10.1007/11744023_32 Karami, E., Prasad, S., & Shehata, M. (2015). Image Matching Using SIFT , SURF , BRIEF and ORB : Performance Comparison for Distorted Images Image Matching Using SIFT, AGU International Journal of Sciences – 2019, Vol. 23 (2), 96 - 108 108 SURF, BRIEF and ORB: Performance Comparison for Distorted Images, (February 2016). https://doi.org/10.13140/RG.2.1.1558.3762 Krishnan, P., & Jawahar, C. V. (2016). Matching handwritten document images. Lecture Notes in Computer Science (Including Subseries Lecture Notes in Artificial Intelligence and Lecture Notes in Bioinformatics), 9905 LNCS, 766–782. https://doi.org/10.1007/978-3-319-46448-0_46 Le Viet Phuong (2015). Logo Detection, Recognition and Spotting in Context by Matching Local Visual Features, (October). Retrieved from https://tel.archives-ouvertes.fr/tel-01373417 Le Viet Phuong., Dang Quoc Bao., & Trần Cao Đệ., (2015). Logo Spotting on Document Images using Local Features. In Proceedings of the Sixth International Symposium on Information and Communication Technology - SoICT 2015 (pp. 1–8). New York, New York, USA: ACM Press. https://doi.org/10.1145/2833258.2833292 Le Viet Phuong, Nayef, N., Visani, M., Ogier, J. M., & Trần Cao Đệ., (2014). Document retrieval based on logo spotting using key- point matching. In Proceedings - International Conference on Pattern Recognition (pp. 3056– 3061). IEEE. https://doi.org/10.1109/ICPR.2014.527 Le Viet Phuong, & Tran Cao De.,(2015). Key- point matching with post-filter using SIFT and BRIEF in logo spotting. In The 2015 IEEE RIVF International Conference on Computing & Communication Technologies - Research, Innovation, and Vision for Future (RIVF) (pp. 89–93). IEEE. https://doi.org/10.1109/RIVF.2015.7049880 Le Viet Phuong, Visani, M., Tran, C. De, & Ogier, J.-M. (2013). Improving Logo Spotting and Matching for Document Categorization by a Post-Filter Based on Homography. In 2013 12th International Conference on Document Analysis and Recognition (pp. 270–274). IEEE. https://doi.org/10.1109/ICDAR.2013.61 Lim, K.-L., & Galoogahi, H. K. (2010). Shape Classification Using Local and Global Features. 2010 Fourth Pacific-Rim Symposium on Image and Video Technology, 115–120. https://doi.org/10.1109/PSIVT.2010.26 Lowe, D. G. (1999). Object recognition from local scale-invariant features. In Proceedings of the Seventh IEEE International Conference on Computer Vision (pp.1150–1157, vol.2). https://doi.org/10.1109/ICCV.1999.790410 Mandle, P., & Pahadiya, B. (2016). An Advanced Technique of Image Matching Using SIFT and SURF, 5(5), 462–466. https://doi.org/10.17148/IJARCCE.2016.5510 9 Raoui, Y., Houssine BOUYAKHF, E., Devy, M., & Regragui, F. (2011). Global and Local Image Descriptors for Content Based Image Retrieval and Object Recognition. Applied Mathematical Sciences, 5(42), 2109–2136. Rusiñol, M., & Lladós, J. (2009). Logo spotting by a bag-of-words approach for document categorization. Proceedings of the International Conference on Document Analysis and Recognition, ICDAR, 111–115. https://doi.org/10.1109/ICDAR.2009.103

File đính kèm:

xay_dung_cong_cu_ho_tro_doc_xuat_ban_pham_luu_chieu_dua_tren.pdf

xay_dung_cong_cu_ho_tro_doc_xuat_ban_pham_luu_chieu_dua_tren.pdf